|

|

|

|

|

[A A] |

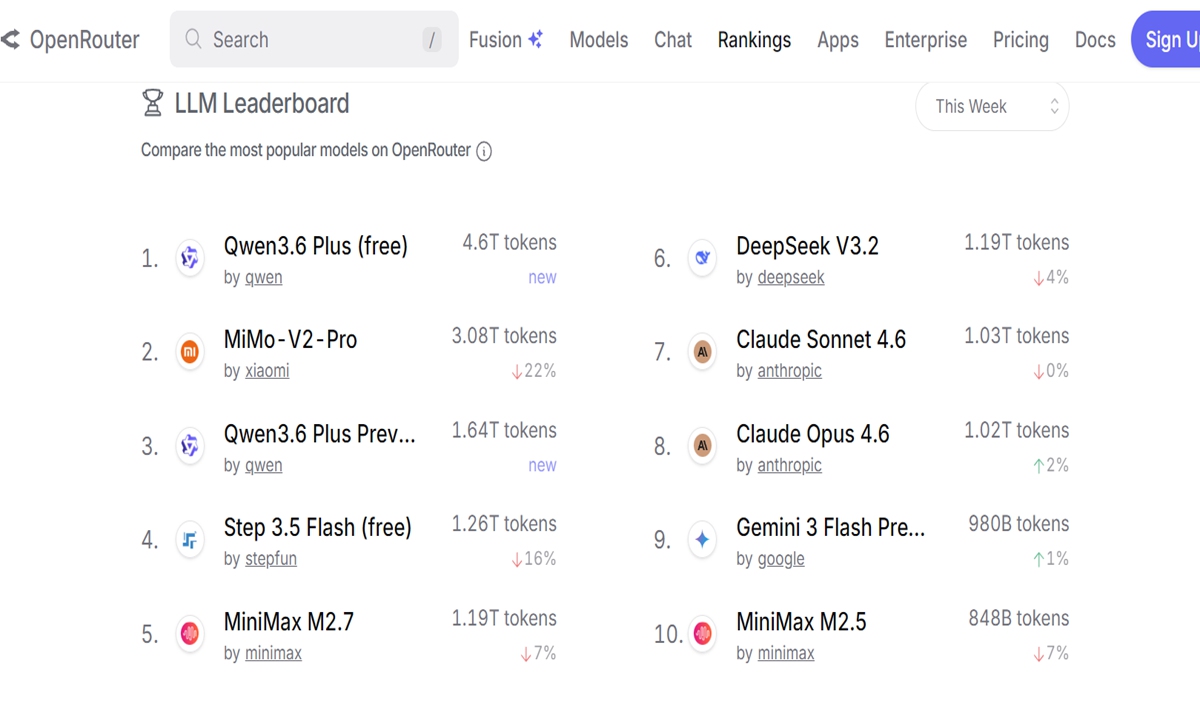

Les modèles d'IA chinois occupent les six premières places du classement mondial en termes d'utilisation

Les grands modèles de langage (LLM) chinois ont dominé le classement mondial en termes d'utilisation durant la semaine du 30 mars au 5 avril. Selon OpenRouter, plateforme mondiale d'agrégation de LLM, les six modèles les plus utilisés en termes de consommation de jetons viennent tous de Chine.

La plateforme de services financiers Stripe décrit la consommation de jetons comme « la manière dont un système, tel qu'un modèle d'intelligence artificielle (IA) ou un réseau blockchain, utilise ses unités de traitement ou d'accès allouées. En IA, les jetons représentent des segments de texte (mots ou parties de mots) que l'IA traite lorsqu'elle génère ou interprète du langage ».

Deux modèles de la série Alibaba Qwen 3.6 figurent parmi le Top 3. Le Qwen 3.6 Plus (gratuit) arrive en tête avec 4 600 milliards de jetons hebdomadaires, tandis que Qwen 3.6 Plus Preview se classe troisième avec 1 640 milliards de jetons, toujours selon OpenRouter.

Cette tendance s’est également confirmée au niveau des modèles. Qwen 3.6 Plus, lancé jeudi, a dominé le classement quotidien d'OpenRouter samedi, avec plus de 1 400 milliards de jetons utilisés en une seule journée, un record pour la plateforme, d'après les données d'OpenRouter et divers médias.

Selon les calculs de médias basés sur les données d'OpenRouter, l'utilisation mondiale des LLM d'IA a atteint 27 000 milliards de jetons du 30 mars au 5 avril, soit une hausse de 18,9 % par rapport à la semaine précédente.

Les modèles chinois ont représenté 12 960 milliards de jetons, en progression de 31,48 %, tandis que les modèles américains ont totalisé 3 030 milliards de jetons, soit une augmentation de 0,76 %. La Chine a ainsi dépassé les États-Unis en termes d'utilisation hebdomadaire pendant cinq semaines consécutives, a rapporté le National Business Daily.

Les données de l'Administration nationale chinoise des données montrent que le nombre moyen quotidien d'appels de jetons en Chine est passé de 100 milliards début 2024 à 140 000 milliards le mois dernier.

« En Chine, les grands modèles s'intègrent rapidement aux plateformes à forte fréquence telles que le commerce électronique, les réseaux sociaux et les services publics, tandis que des stratégies tarifaires agressives, dont notamment un accès gratuit, ont considérablement réduit les barrières à l'adoption et ont élargi la base d'utilisateurs », a souligné lundi Wang Peng, chercheur associé à l'Académie des sciences sociales de Beijing.

« La consommation de jetons est structurellement plus élevée en raison de l'expansion rapide des agents d'IA et des flux de travail complexes », a noté M. Wang. « Ces systèmes reposent sur un raisonnement itératif, un traitement contextuel étendu et des appels enchaînés, ce qui signifie qu'une seule tâche peut consommer plusieurs fois plus de jetons que les interactions traditionnelles. »

« Plus fondamentalement, la Chine bénéficie d'atouts conjugués en matière de puissance de calcul, d'approvisionnement énergétique et de déploiement rentable », a-t-il ajouté.

Les vastes clusters de centres de données, l'intégration des infrastructures informatiques et électriques, ainsi que l'optimisation continue de l'efficacité de l'inférence permettent un débit plus élevé à moindre coût. Plus important encore, la Chine possède l'un des écosystèmes d'applications Internet les plus riches au monde, où les LLM sont profondément ancrés dans des scénarios économiques réels, ce qui se traduit directement par une demande soutenue et importante de jetons, a indiqué M. Wang.

Pour soutenir la croissance de l'IA, le Rapport d'activité du gouvernement chinois de cette année a dévoilé des plans de lancement de nouveaux projets d'infrastructure axés sur les clusters de calcul intelligents hyperscale, parallèlement au développement coordonné des capacités de calcul et de l'approvisionnement énergétique, selon l'agence de presse Xinhua.

| Source:french.china.org.cn |  |

|

|